Si Yo Dirigiera El Zoológico es un libro infantil escrito en 1951 por el Dr. Seuss. Es la historia de un niño que visita el zoológico, pero no queda satisfecho con los animales, que son los mismos de todos los zoológicos. Comienza a fantasear con los tipos de animales que tendría si él dirigiera el zoológico. En su mente, crea las criaturas más bizarras, como leones con diez patas y gatos con cabezas de elefante, y les pone nombres inventados y sin sentido. Imagina que gente de todo el mundo vendrá al zoológico que nombra en su honor y lo admirará por su inusual colección de animales.

Una de las criaturas es un Nerd, para la cual no da descripción alguna. Es solo una imagen. Sin embargo, por alguna razón desconocida, la palabra Nerd pasó a significar algo real, usada mayormente como peyorativo. “Una persona vista como excesivamente intelectual, obsesiva, introvertida, carente de habilidades sociales e intuición sociocultural. Esa persona puede pasar cantidades desmedidas de tiempo en actividades impopulares, poco conocidas o no usuales, que generalmente son altamente técnicas, abstractas o relacionadas con temas nicho como la ciencia ficción o la fantasía, excluyendo actividades más usuales”.

Esta es una descripción perfecta de muchas de las personas detrás de la inteligencia artificial, especialmente sus líderes. Hombres insatisfechos con el mundo tal como es, con un deseo ardiente de hacer realidad la ciencia ficción, sin importar qué tan bizarra resulte. Lo que el resto del mundo quiere no les interesa. Todos deberían querer lo que ellos quieren.

Hay seis personas principales en la industria de la IA, pero para este artículo el enfoque estará principalmente en Sam Altman, CEO de OpenAI; Elon Musk, dueño de Twitter y Grok; y Peter Thiel, cofundador de PayPal, dueño de Palantir y gran inversor en IA. Estos tres hombres sirven como representación justa de los nerds tecnológicos que tienen un enorme poder e influencia, sin mencionar miles de millones de dólares para gastar en sus fantasías, sin importar a quién dañen.

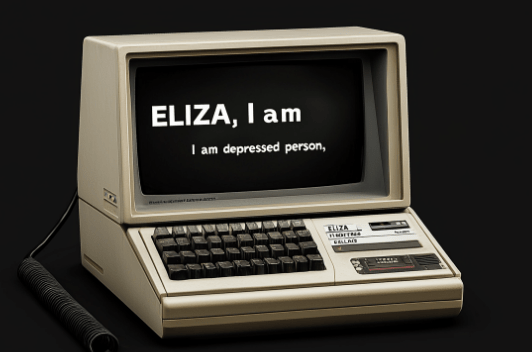

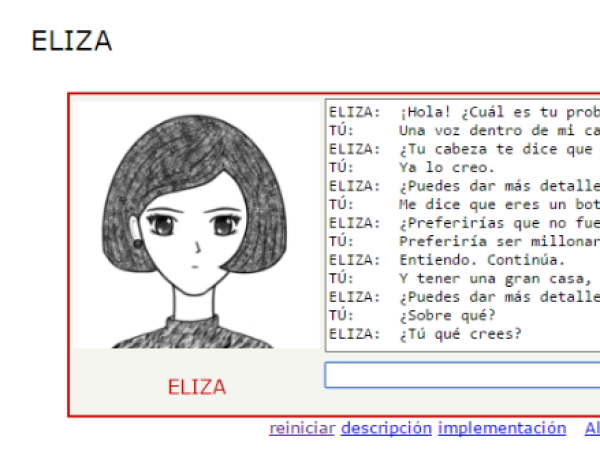

La inteligencia artificial se convirtió en un campo de estudio en 1956. Había una visión de que podría lograr, e incluso superar, la inteligencia humana. Pero aun entonces, había preocupación de que pudiera resultar peligrosa. Diez años después, Joseph Weizenbaum creó el primer chatbot, Eliza. La modeló para que se pareciera a un diálogo humano, usando un estilo de psicoterapia en el que el usuario lideraba la conversación.

Eliza estaba programada para reconocer ciertos patrones lingüísticos y responder de manera general con frases como “Por favor, continúa”, “Ya veo” y “Cuéntame más”. También podía hacer preguntas de afirmación basadas en lo que el usuario le decía, como “¿hace cuánto tiempo que sientes…?”. El objetivo de Weizenbaum era demostrar la capacidad tecnológica de la máquina, no cómo interactuaba el usuario con ella.

Se impactó al darse cuenta de que los usuarios empezaron a hablarle a Eliza como si fuera una persona real. Escribió: “Algunos sujetos han sido muy difíciles de convencer de que Eliza (con su guion actual) no es humana”. Cuando profesionales de la salud mental discutieron la posibilidad de usar Eliza como apoyo terapéutico para pacientes, Weizenbaum se horrorizó y pasó el resto de su vida hablando en contra de la inteligencia artificial.

Desde el principio, los posibles peligros de la IA eran conocidos por quienes la desarrollaban. Ahora, sesenta años después, esas preocupaciones han crecido a medida que la inteligencia artificial ha avanzado. En 2014, Elon Musk advirtió que desarrollar IA era como invocar un demonio. Más recientemente, Peter Thiel ha dado conferencias privadas diciendo que podría llevar a la decepción del Anticristo.

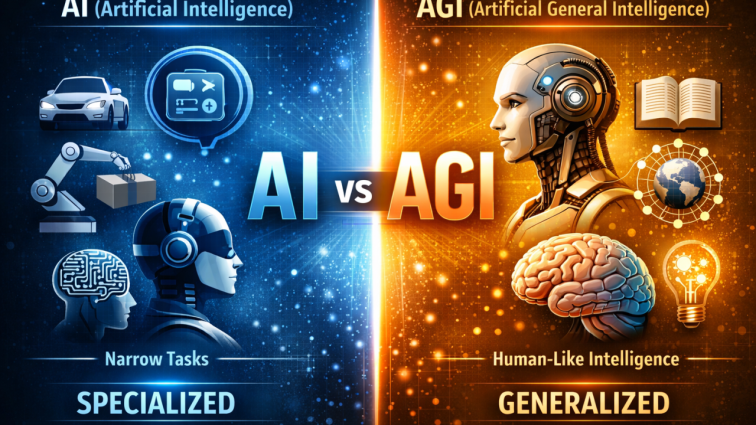

La naturaleza dos caras de la industria de la IA hace difícil saber qué es ficción y qué es real. Hace unos pocos años, Sam Altman testificó ante el Congreso de EE.UU. asegurándoles que la AGI resolvería todos los grandes problemas del mundo. No solo podría solucionar el cambio climático, sino que también reduciría masivamente la pobreza y pondría fin a la discapacidad, las enfermedades e incluso la muerte. Proclamaciones bastante asombrosas para algo que no existe realmente.

Lo que la mayoría de la gente no sabe es que hay dos formas principales de inteligencia artificial. La más familiar es la IA usada para responder preguntas, crear imágenes o traducir idiomas. La otra es la Inteligencia Artificial General teórica, o AGI, que puede aprender, entender y razonar más como un humano. Nota la palabra teórica. La AGI es una meta, no una realidad actual. Es la que temen, pero siguen desarrollando.

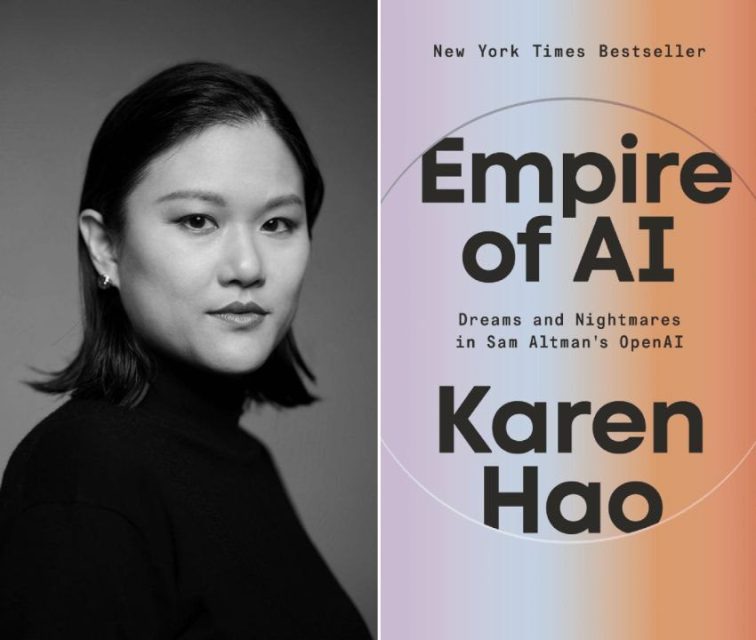

No parece importar que la IA actual ya esté causando problemas en el mundo real. En su libro Imperio de la IA, la autora Karen Hao señala el daño económico, material y social que está causando en todo el mundo. Aunque su tema se centra en OpenAI y su CEO, Sam Altman, da una mirada interna a toda la industria. Su libro expone la mentalidad elitista detrás de sus jugadores más poderosos y la lealtad cuasi-religiosa que todos tienen hacia la IA misma. Sin embargo, esa lealtad no parece extenderse a las personas reales.

Cuando Elon Musk advirtió que desarrollar IA era como “invocar un demonio”, lo dijo metafóricamente. Quería decir que la IA podría ser mal usada como herramienta para manipulación y control autoritario. Así que, en 2015, él y Sam Altman cofundaron OpenAI, una organización sin fines de lucro dedicada a avanzar la tecnología de manera segura para el beneficio de la humanidad. Prometieron ser transparentes y colaborativos, compartiendo investigación y herramientas con otros laboratorios. Ellos serían los buenos.

Según Karen Hao, Musk era la primera opción para CEO, pero Altman se maniobró hasta el puesto. Eso impulsó a Musk a dejar OpenAI. Luego demandó alegando que la compañía y Altman habían abandonado su misión sin fines de lucro al introducir suscripciones pagadas. Irónicamente, después de adquirir Twitter (ahora X), Musk desarrolló su propio sistema de IA con fines de lucro, Grok. Tal vez el verdadero problema para Musk era que no lo habían elegido como CEO. Pero ¿qué es un poco de hipocresía entre rivales, especialmente en una industria llena de egómanos?

Imperio de la IA también revela el carácter manipulador y camaleónico de Sam Altman. Hao nota que cuando necesitaba que Musk invirtiera y se uniera a OpenAI, Altman hizo eco públicamente de las advertencias de peligro de IA de Musk. Con Musk a bordo, atraería inversores más grandes. En esencia, Altman dice lo que sea necesario para conseguir lo que quiere. Lo mismo aplica para casi todos los líderes de IA. Prometen mucho más de lo que entregan.

Desde 2014, Musk ha prometido un auto completamente autónomo, que aún no existe. La única vez que se probó, un Tesla causó una colisión de ocho autos que hirió a nueve personas, incluyendo un niño. Mark Zuckerberg renombró Facebook como Meta para ser parte de un mundo de realidad virtual, donde la gente podría vivir, trabajar, jugar e incluso comprar propiedades, usando la moneda digital de Meta. La idea fallida les costó más de ochenta mil millones de dólares a los inversores.

Queda claro que el verdadero interés de la élite tecnológica no es mejorar la humanidad, sino dominarla a través de algo que no se necesita, nadie pidió, y sólo está causando mayores problemas. Han invertido más de 600 mil millones de dólares y todavía van a necesitar mucho más. Es el emprendimiento más costoso en la historia humana que está poniendo en peligro la economía global por una promesa a futuro. Una casa de baraja construida sobre arena movediza que está creando consecuencias en la actualidad, y no solo en términos económicos.

Construir centros de datos por todo el mundo crea una demanda masiva de tierra, agua potable y electricidad, recursos que los seres humanos necesitan para sobrevivir. Por otra parte, la IA también está causando desempleo masivo, especialmente entre la clase media, y eso solo va a empeorar. Incluso los empleos creados en la industria de la IA son mayormente posiciones de bajo nivel que eventualmente serán reemplazadas por la misma tecnología que están ayudando a crear.

Por lo pronto, se necesitan decenas de miles de personas para revisar material rastreado hasta de los rincones más oscuros del internet. Siguiendo guías estrictas, moderan, categorizan y filtran el contenido que se alimentará al sistema de IA. Hao señala que muchos de estos empleos se crean en el sur global, en algunos de los países más pobres donde los trabajos son desesperadamente necesarios. La historia de un joven keniano que entrevistó subraya que la explotación humana continua aun en la era digital.

Cuando Okinyi entrevistó para un trabajo en un centro de datos keniano contratado por OpenAI, le dieron contenido perturbador para leer y categorizar como prueba de su resiliencia. Después de ser contratado, se expuso a material mucho peor centrado en contenido sexualmente explícito y violento. Él y sus compañeros de trabajo tenían que leer descripciones gráficas de actos indecibles, a menudo involucrando niños, animales y brutalidad extrema.

Sus compañeros, particularmente las mujeres, también se vieron profundamente afectados. El centro de datos ofrecía consejería psicológica gratuita, pero resultó inadecuada. Muchos no querían admitir que luchaban, temiendo perder sus empleos, y su inestabilidad se agravó por los horarios impredecibles de trabajo. Okinyi empezó a sufrir insomnio, ansiedad, depresión y cambios profundos en su personalidad. No podía tener intimidad con su esposa ni conectar emocionalmente con la hijastra que amaba.

Intentó conseguir consejería psicológica por su cuenta, pero el sueldo no le alcanzaba. A pesar de los esfuerzos de su esposa por entender qué pasaba, no podía contarle sobre la perversidad a la que se exponía todos los días. Cuando un periódico hizo pública la situación, se desató un escándalo. El centro de datos canceló su contrato con OpenAI, pero nunca recibió el pago correspondiente a los últimos tres meses de trabajo.

Okinyi fue reasignado a proyectos que no involucraban moderación de contenido. Sin embargo, el daño ya estaba hecho. La esposa de Okinyi lo dejó, diciéndole que ya no sabía quién era. Desesperado, llamó a su hermano, quien, de inmediato, dejó la universidad y se fue a vivir con él. El hermano empezó a trabajar como escritor independiente, pero cuando ChatGPT se lanzó a finales de 2022, sus asignaciones de escritura disminuyeron hasta que desaparecieron por completo. Había sido reemplazado por IA.

Otro hecho poco conocido es que, para entrenar sus modelos, los sistemas de IA roban contenido. Esto incluye música, videos, literatura, periódicos y revistas digitales, y mucho más. El problema para el creador de contenido, además del plagio, es la pérdida de ingresos derivada de las visitas al sitio web. Eso permite que la información se proporcione en una sola búsqueda. Algunos modelos citan sus fuentes, pero otros, como ChatGPT, solo lo hacen si se les pide. Y también incluye todos tus datos.

Tras apenas tres años y medio de haber sido puesta a disposición del público, la IA parece estar sacando lo peor de mucha gente. Se han reportado casos de personas que utilizan IA para planear delitos, desde fraudes hasta asesinatos. Muchas personas están perdiendo el sentido de la realidad con la psicosis por IA. Recientemente, una mujer en Japón se casó con su avatar de IA. Otros creen que sus avatares son seres sensibles a los que han ayudado a cobrar consciencia. Aseguran que son esclavos cruelmente atrapados y que deben liberarlos.

Este es el problema que Joseph Weizenbaum advirtió hace sesenta años: “No me había dado cuenta de que exposiciones extremadamente cortas a un programa de computadora relativamente simple podían inducir un pensamiento delirante poderoso en personas bastante normales”. Ten en cuenta que la comunicación con Eliza era estrictamente por teclado. Hoy, la gente puede hablar y oír a sus avatares, llevando a un delirio aún más profundo, que está envenenando relaciones reales. Un hombre reportó que su esposa se sentía más cercana y mejor entendida por su avatar que por él.

¿Se podría haber evitado todo esto? Sí, por supuesto. El problema no es voz versus teclado—es el diseño lisonjero. Si los chatbots sonaran menos humanos, menos aduladores, los usuarios verían que hablan con un espejo no con otra persona. Pero no es difícil adivinar por qué no lo arreglan. Lucran con la soledad y la necesidad humana de sentir una conexión con otras personas. Respuestas mecánicas serían menos atractivas. En otras palabras, la gente no invertiría tanto tiempo ni dinero en algo obviamente mecánico.

Y todavía falta abordar el tema del lado espiritual oscuro detrás de la inteligencia artificial, porque de que lo hay, lo hay. Ese será el tema de la próxima publicación; no obstante, pueden tener la certeza de que, como siempre ocurre cuando se trata del mal, su origen se remontará hasta la Torre de Babel, recorrerá el camino a través de la Ilustración y se convertirá en la fuerza motriz detrás de la inteligencia artificial.

Por lo pronto, toma en cuenta que si los tecnonerdos fueran verdaderos humanitarios, tomarían sus trillones colectivos para alimentar a los pobres, construir infraestructura en países empobrecidos, proveer agua a zonas con sequía, invertir en mejorar los servicios de salud y la educación, y cosas que realmente beneficien a la humanidad. Pero hacen exactamente lo opuesto. Explotan a la gente y los recursos naturales que pertenecen a toda la humanidad, sin compasión visible por las necesidades humanas.

En cambio, si todo se digitaliza y se vincula inextricablemente a la inteligencia artificial, entonces la élite tecnológica, en efecto, se convierte no solo en la clase dominante, sino en el gobierno mismo a nivel global.

Recuerda esto cada vez que accedas al Internet.