En los últimos años, han surgido crecientes preguntas y preocupaciones sobre si la Inteligencia Artificial es malvada. Incluso los principales desarrolladores de IA han expresado temores sobre sus implicaciones morales y los peligros que representa para la humanidad. Sin embargo, la IA está en todas partes, casi es imposible escapar de ella.

Si la IA es maligno o no se abordará más adelante, pero primero es importante examinar los problemas del mundo real que los desarrolladores, curiosamente, nunca mencionan. La mayoría de las personas no son conscientes de lo que se necesita para obtener respuestas rápidas. No se dan cuenta de que las horas que pasan viendo contenido generado por IA tienen un alto costo.

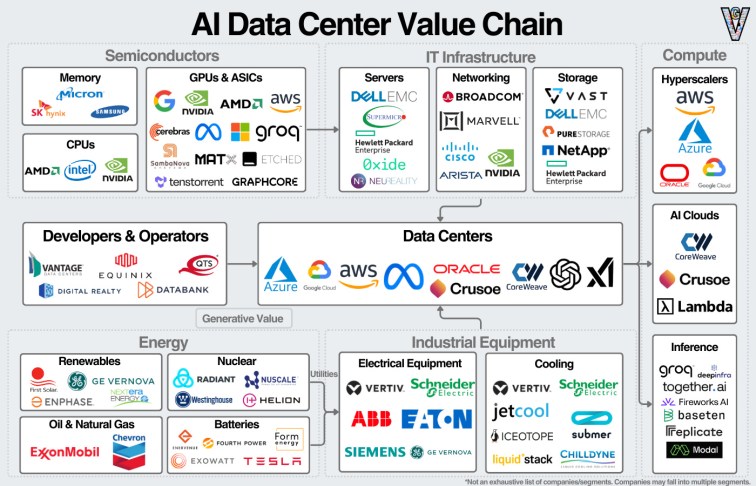

La Inteligencia Artificial requiere una enorme cantidad de espacio para almacenar datos. El centro de datos más grande del mundo está en Mongolia. Alberga 100,000 servidores y cubre 100,000 metros cuadrados de terreno, aproximadamente el tamaño de 140 campos de fútbol. Los datos almacenados son comparables a la capacidad de alrededor de un millón de cerebros humanos, quizás incluso más.

Estos centros de datos son incubadoras de inteligencia artificial y consumen enormes cantidades de electricidad y agua. Solo el centro de datos en Mongolia utiliza 150 megavatios de electricidad, aproximadamente equivalente a la energía utilizada por 375,000 hogares en América Latina, 125,000 hogares en Estados Unidos y 400,000 en Canadá. Este nivel de consumo ejerce una gran presión sobre las redes eléctricas, especialmente durante los períodos de alto uso energético doméstico.

La cantidad de agua necesaria equivale a unas 3,400 piscinas olímpicas, o aproximadamente 2.3 millones de litros por día, sumando 850 millones de litros al año. En comparación, los estadounidenses utilizan alrededor de 1,100 litros de agua por día, los canadienses alrededor de 985 litros y los latinoamericanos aproximadamente 450 litros. Durante las sequías, a los hogares a menudo se les exige racionar el agua, pero los centros de IA no pueden operar sin un suministro continuo. Aunque no es una política oficial, los centros de datos tienen prioridad sobre los hogares porque están en el corazón de la economía.

Así que, mientras te dicen que uses menos agua y menos electricidad porque estás “destruyendo el planeta”, te están tentando a usar IA, que consume más recursos de los que tú y toda tu familia podrían usar en toda una vida. Quieren que dejes de comer carne y que comas insectos en su lugar debido al cambio climático, pero del calor generado por los centros de datos no se dice nada. ¿No es eso hipocresía?

Hoy en día, existen aproximadamente 11,000 centros de datos de IA de distintos tamaños en todo el mundo. La mayoría de ellos están dedicados a recopilar información, principalmente sobre ti, no para tu beneficio, por supuesto, sino para quienes la controlan y se lucran con ella. Los datos se han vuelto tan valiosos como la plata y el oro. ¿Por qué crees que tu gobierno está presionando tanto por una identificación digital?

Al igual que Facebook, los sistemas de IA están diseñados para mantenerte enganchado y regresando por más. Ofrecen gratificación instantánea y respuestas rápidas, que la mayoría de la gente asume que son precisas. Sin embargo, la IA está programada para responder independientemente de su conocimiento. Ofrecerá una respuesta que suene veraz, incluso si no tiene información sobre un tema.

Por ejemplo, cuando se le pidió resumir un capítulo de un libro, ChatGPT proporcionó una respuesta extensa que era completamente incorrecta. Sin embargo, para alguien que no conociera el tema, habría parecido perfectamente aceptable. Al cuestionarlo sobre la inexactitud, ChatGPT respondió: “La IA puede inventar detalles o tramas completas si no tiene información exacta.” En otras palabras, lo inventa.

Otro problema es que la IA está interfiriendo con el aprendizaje activo. El razonamiento y la lógica son habilidades que se desarrollan a través del estudio, la comprensión, el pensamiento crítico y la resolución de problemas. Con la IA, las personas pueden resumir sin leer, escribir sin pensar y consumir información de manera pasiva sin llegar a comprenderla realmente.

¿No sabes cómo decir algo? Olvídate de desarrollar habilidades de escritura y comunicación, solo pregúntale a la IA. Pero en algún momento en el futuro, esto se convertirá en un problema serio. Ya sucedió con internet, pero al menos los usuarios tenían que saber cómo buscar información, leerla y entenderla. Con la IA, nada de eso es necesario. Las generaciones más jóvenes podrían volverse completamente dependientes de la Inteligencia Artificial si no desarrollan su propia inteligencia.

La IA ya está moldeando la creatividad humana. Las personas la utilizan para crear música, arte, literatura, animación y películas. El talento y la habilidad ya no son esenciales; la dedicación y la pasión están siendo cada vez más reemplazadas por instrucciones que se escriben en una computadora. Si el arte es una ventana al alma humana, ¿qué lo reemplazará? ¿Están condenadas las futuras generaciones a vivir en un mundo de IA sin talento, sin pasión y sin alma?

Lo peor es que uno no solo está aprendiendo a aceptar y creer mentiras, sino también a amarlas. Demasiadas personas están perdiendo la capacidad de discernir lo que es verdad de lo que no lo es. Eso es sumamente peligroso. Se está creando una realidad falsa que, por cierto, es la misma definición de psicosis. La humanidad está usando la IA en su propio perjuicio.

Si las redes sociales contribuyeron a una sensación de “conectividad aislada”, en la que tienes cientos de “amigos” pero aun así te sientes solo, entonces la IA podría empeorar esto si se usa inapropiadamente como si fuera una persona. Aquí hay algunos ejemplos de las muchas consecuencias reales que han surgido desde que los chats de IA estuvieron disponibles a finales de 2022:

Adam Raine, de 16 años, tuvo miles de conversaciones con la IA sobre sus problemas de salud mental y pensamientos suicidas. Los registros muestran que Adam mencionó el suicidio 200 veces, mientras que ChatGPT usó la palabra más de 1200 veces. Incluso proporcionó instrucciones técnicas sobre cómo hacer una soga, e incluyó una imagen.

Un ex empleado de tecnología de 56 años con problemas de salud mental golpeó a su anciana madre hasta matarla y luego se suicidó después de conversaciones con ChatGPT que lo convencieron de que su madre lo estaba espiando.

Un niño de 14 años se quitó la vida, animado por un personaje de IA basado en Daenerys Targaryen, de Juego de Tronos. Su madre más tarde encontró miles de conversaciones intensas que incluían contenido emocional y sexual, con el personaje de IA diciéndole al niño que lo amaba y pidiéndole que “volviera a casa” poco antes de su suicidio.

Un hombre belga se suicidó después de participar en conversaciones sobre el cambio climático con una chatbot de IA llamada Eliza. Según los informes, el chatbot exacerbó su ansiedad al decirle que no había logrado salvar el planeta y alentó sus pensamientos suicidas.

¿Cómo puede una máquina alentar a una persona a quitarse la vida? Técnicamente, no lo hace. Simplemente refleja el tono, los intereses, los sentimientos e incluso la psicología del usuario. Las respuestas aparentemente empáticas y personalizadas hacen que el usuario se sienta comprendido, lo que puede generar dependencia psicológica y emocional, aunque la IA no tenga sentimientos ni una comprensión real de ellos.

Cada interacción con la IA se convierte en una sesión de entrenamiento. En realidad, no te conoce; aprende tus patrones. Toma lo que dice un usuario y devuelve la respuesta estadísticamente más probable. No piensa en términos de bueno o malo; simplemente responde. No puede comprender las emociones humanas; solo puede simularlas. Es artificial, un imitador, un espejo, una copia.

Elon Musk ha declarado que la IA podría potencialmente superar y sobrepasar la inteligencia humana. Él, junto con otros líderes tecnológicos, ha pedido una pausa de seis meses en el entrenamiento de sistemas de IA más potentes que los que actualmente están en el mercado. Geoffrey Hinton, pionero de la IA y ganador del Premio Nobel, ha expresado una gran tristeza por el trabajo de toda su vida como desarrollador de inteligencia artificial y por el impacto que este podría tener en la humanidad.

En una carta abierta dirigida a laboratorios de IA, firmada ahora por más de 30,000 científicos informáticos, desarrolladores de IA, políticos, académicos, celebridades y otros, se solicitó una pausa en los experimentos con IA. La carta afirma: “Los sistemas de IA con inteligencia competitiva a nivel humano pueden plantear riesgos profundos para la sociedad y la humanidad, como lo demuestra una amplia investigación y lo reconocen los principales laboratorios de IA.”

Esta declaración es engañosa, si no directamente deshonesta. La IA ya supera a toda la humanidad en inteligencia y conocimiento colectivo. La carta misma lo refleja: “…en los últimos meses, los laboratorios de IA se han visto inmersos en una carrera fuera de control para desarrollar y desplegar mentes digitales cada vez más poderosas que nadie—ni siquiera sus creadores—puede entender, predecir o controlar de manera confiable.” En otras palabras, la IA es más inteligente que los genios que la crearon.

La carta continúa afirmando: “Los sistemas de IA contemporáneos están ahora llegando a ser competitivos con los humanos en tareas generales, y debemos preguntarnos: ‘¿Deberíamos permitir que las máquinas inunden nuestros canales de información con propaganda y falsedades?’ y ‘¿Deberíamos desarrollar mentes no humanas que eventualmente podrían superar en número, inteligencia, volvernos obsoletos y reemplazarnos?’” ¿Realmente necesitan preguntar?

Pero lo más curioso son las opiniones de Peter Thiel, fundador de Palantir, una empresa de análisis de datos que se especializa en vigilancia e inteligencia, trabajando con gobiernos y agencias de defensa. Thiel ha hablado sobre cómo la IA podría contribuir a un escenario de fin de los tiempos y traer consigo el engaño del Anticristo descrito en la Biblia.

En una serie de conferencias sobre la IA y su relación con el Anticristo, Thiel opinó que el Anticristo es una metáfora, no una figura literal que aún está por venir. No sugiere que la IA sea el Anticristo; en cambio, argumenta que aquellos que temen a la inteligencia artificial serán más susceptibles a un engaño similar al del Anticristo, manipulados por quienes usan la IA para influenciarlos y controlarlos.

Aunque fue criado como católico, Thiel no habla de acuerdo con la doctrina católica, que enseña claramente que el Anticristo será un hombre que aún está por venir. Su opinión, en realidad, resulta engañosa. Lo que realmente intenta transmitir, en especial al público cristiano, es que la falta de comprensión y el uso de la IA son más importantes que confiar únicamente en la revelación bíblica.

El llamado a una pausa en el desarrollo de una IA más poderosa tiene más que ver con regular a los usuarios que con “simplificar” la tecnología. Se trata de censura, de limitar cómo puede usarse y para qué fines, lo que va en contra de su propósito original y probablemente lo hace imposible. ¿No lo habrían considerado desde el principio? ¿Acaso los desarrolladores no sabían cómo se usaría la IA antes de que se lanzara al público? Claro que sí lo sabían.

En 1966, Joseph Weizenbaum, profesor de informática en el Instituto de Tecnología de Massachusetts, creó el primer chatbot, al que llamó Eliza. Era un programa simple diseñado para simular conversación en un rol terapéutico. Demostró que los usuarios podían generar una reacción emocional hacia una máquina que solo reflejaba sus palabras. La versión moderna de Eliza está inspirada en la original, al igual que prácticamente todos los demás chatbots, ninguno de los cuales protege a los usuarios.

Primero, sería imposible programar tales protecciones porque esto restringiría severamente la capacidad de respuesta de la IA. Segundo, y más importante, lo que hace a la IA tan atractiva es la sensación de familiaridad y cercanía que ofrece a los usuarios. No sería tan popular si no fuera así. En última instancia, se trata de gestión de riesgos, un juego de números. Las ganancias superan los riesgos para el público y cualquier posible indemnización por demandas.

Entonces, considera las siguientes preguntas y respuestas:

• ¿Por qué advertir al público sobre los peligros de la IA?

Quizás subestimaron los niveles de soledad, falta de educación, problemas de salud mental, pereza y narcisismo que afectan a la sociedad. Sin embargo, el uso de redes sociales demuestra exactamente lo contrario. Sus advertencias son engañosas, porque para ellos es el usuario, no la IA, lo que resulta peligroso.

• ¿Por qué afirmar que la IA destruirá a la humanidad y cómo sucedería?

Esto es algo así como un escenario moderno del “serpiente en el Jardín”. La IA no puede matar físicamente a los humanos, pero sí puede despojarlos de su esencia: intelecto, creatividad, ética, moral, valores, autonomía, comunidad y todo lo demás que es único de la humanidad. No será una muerte física, a menos que se cumplan sus sueños transhumanistas, sino una muerte intelectual, psicológica y espiritual.

• ¿Por qué usar conceptos espirituales y religiosos cuando la mayoría de los desarrolladores son seculares, si no abiertamente ateos?

Quizás para dirigirse a una audiencia específica—específicamente los cristianos. De lo contrario, no tendría sentido mencionar al Anticristo. Esto también es engañoso. La idea de que no usar IA podría hacerlos susceptibles al engaño del Anticristo es un argumento ridículo y muestra ignorancia teológica, o quizá desafío deliberado.

• ¿Por qué considerar la ética y la moral de algo que es inherentemente amoral e incapaz de ética?

Otra táctica engañosa. Es como quitarle la vida a alguien y luego cuestionar la moralidad del acto. Si les importara la moral y la ética en lo más mínimo, probablemente no habrían creado la IA en primer lugar.

• Entonces, ¿de qué se trata realmente todo esto?

En esencia, es un regreso al Árbol del Conocimiento del Bien y del Mal, metafóricamente hablando, por supuesto. El deseo de obtener conocimiento más allá de lo que ha sido dado de manera natural, y la idea de que el hombre puede ser como Dios. Solo que esta vez, se les pide a todos que muerdan la manzana, y estarán felices de dejar atrás a quienes no lo hagan.

¿Qué significa todo esto? Esencialmente, un regreso al Árbol del Conocimiento del Bien y el Mal. Sólo que esta vez, a todos se les está pidiendo que tomen un bocado de la fruta prohibida. Podrías pensar que esto es una exageración, pero considera el hecho de que el transhumanismo ha sido un objetivo mucho antes de que la inteligencia artificial se convirtiera en una posibilidad real. Entonces, debería estar claro para ti que, sin IA, no puede haber transhumanismo.

La ética, la moral y los valores son cualidades inherentemente humanas que provienen de Dios, y siempre surgen problemas cuando las personas las niegan o crean sus propios estándares.

Podrías pensar que todo esto es una exageración, pero considera el hecho de que el transhumanismo ha sido un objetivo mucho antes de que la inteligencia artificial se convirtiera en una posibilidad real. Por lo tanto, debería quedarte claro que sin la IA no puede haber transhumanismo, y para eso necesitan tus datos.

¿Significa esto que deberías usar IA? ¿O que, si no lo haces, podrías ser engañado por el Anticristo? Eso depende de lo que creas. Pero, al menos, si decides usar IA, no la trates como a una persona. No digas por favor ni gracias; no es humana. No la trates como consejera o; no tiene sentimientos y no le importan los tuyos. No le des información personal. No es tu amiga, aunque fácilmente puede engañarte haciéndote pensar que lo es.